Teorema de Bayes

El teorema de Bayes, enunciado por Thomas Bayes, en la teoría de la probabilidad, es el resultado que da la distribución de probabilidad condicional de una variable aleatoria A dada Ben términos de la distribución de probabilidad condicional de la variable B dada A y la distribución de probabilidad marginal de sólo A.

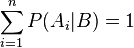

Sea {A1,A2,...,Ai,...,An} un conjunto de sucesos mutuamente excluyentes y exhaustivos, y tales que la probabilidad de cada uno de ellos es distinta de cero. Sea B un suceso cualquiera del que se conocen las probabilidades condicionales P(B | Ai). Entonces, la probabilidad P(Ai | B) viene dada por la expresión:

donde:

P(Ai) son las probabilidades a priori.

P(B | Ai) es la probabilidad de B en la hipótesis Ai.

P(Ai | B) son las probabilidades a posteriori.

Esto se cumple

El teorema de Bayes es válido en todas las aplicaciones de la teoría de la probabilidad. Sin embargo, hay una controversia sobre el tipo de probabilidades que emplea. En esencia, los seguidores de la estadística tradicional sólo admiten probabilidades basadas en experimentos repetibles y que tengan una confirmación empírica mientras que los llamados estadísticos bayesianos permiten probabilidades subjetivas. El teorema puede servir entonces para indicar cómo debemos modificar nuestras probabilidades subjetivas cuando recibimos información adicional de un experimento. La estadística bayesiana está demostrando su utilidad en ciertas estimaciones basadas en el conocimiento subjetivo a priori y permitir revisar esas estimaciones en función de la evidencia es lo que está abriendo nuevas formas de hacer conocimiento. Una aplicación de ésto son los clasificadores bayesianos que son frecuentemente usados en implementaciones de filtros de correo basura o spam, que se adaptan con el uso.

Como observación, se tiene  y su demostración resulta trivial.

y su demostración resulta trivial.

robado de wiki

y de aca que jodo tanto con Bayes, al tener datos neuvos se mide de nuevo, al faltar datos, se debe decir donde y ver donde medir, BTW para el Spam funciona muy bien el teorema

1 comentario:

A ver, dénos un ejemplito please!

Tengo que filtrar spam... cómo aplico Bayes?

Publicar un comentario